SEO每天一贴很少写关于必应Bing或雅虎Yahoo!的事,原因显而易见:他们那可怜的市场份额真不大值得写。

微软虽然一直对搜索不离不弃,投入重金和时间,但到目前为止,Bing在搜索市场从来都是个陪衬。Yahoo!就更甭提了,在收购了除Google、Bing以外的所有搜索引擎之后,Yahoo!竟然自废武功,把自己多年积累、收购的所有搜索技术彻底放弃了,雅虎网站的搜索功能转为使用Bing的技术 – – 不禁让人心里嘀咕:确定不是Google卧底干的吗?一个最重要的对手就这么没了?

不过Bing对SEO们一直都是挺友好的,而且Bing工程师们给SEO行业不少很有建设性的意见。比如,关于外链建设,我觉得最精彩的一句话就是某位必应工程师说的,大意是,最好的外链是那些你根本不知道其存在的外链。

必应大幅提高URL提交限额

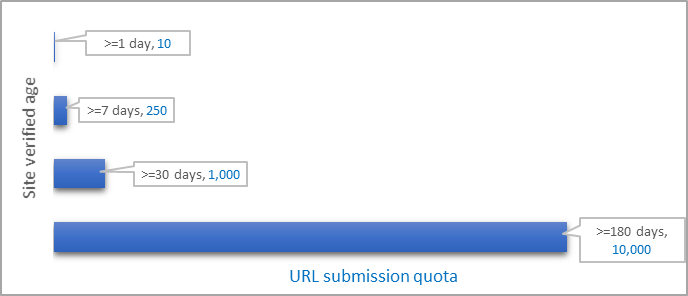

一月底Bing站长博客发了一篇帖子,表示Bing站长工具URL提交工具做了升级,大幅提高站长可以提交的URL数目上限,从原来的每天只能提交10个,每个月最多50个,增长1000倍,现在每天可以提交10,000个,没有月上限。唯一的限制是,网站需要在Bing站长工具注册验证180天以上:

帖子还说了很有意思的一段话,如果以后搜索引擎按这个方向发展的话,SEO们未来可能不用再操心页面爬行、抓取的问题了:

We believe that enabling this change will trigger a fundamental shift in the way that search engines, such as Bing, retreive and are notified of new and updated content across the web. Instead of Bing monitoring often RSS and similar feeds or frequently crawling websites to check for new pages, discover content changes and/or new outbound links, websites will notify the Bing directly about relevant URLs changing on their website. This means that eventually search engines can reduce crawling frequency of sites to detect changes and refresh the indexed content.

翻译过来大意是:

我们相信这个变化会引发搜索引擎发现及抓取新内容(包括新建或更新的内容)方式的根本性变革。站长将可以直接通知Bing网站上有了URL变化,而不需要Bing通过监控RSS或频繁爬行来发现新页面。这实际上意味着搜索引擎在发现、更新索引内容时,可以降低对网站的爬行频率。

内容索引不再依靠爬行?

一直以来,我觉得SEO有三大难点:内容、内部链接结构、外链建设。其中,网站内部链接结构就是要解决搜索引擎有效爬行、抓取的难题,既要抓得全,抓得快,又要避免抓取不必要的内容,还得合理分配权重。越是大站,这个问题越难完美解决。做过大站的SEO一定都深有体会,不管怎样调整网站结构,都无法做到页面100%被索引。

必应的这篇帖子在告诉SEO们,以后很可能不用担心抓取的问题了,有了新页面,或者旧页面有了更新,直接提交URL就行了(通过站长工具或API),不必依靠Bing蜘蛛爬行抓取,实际上,Bing蜘蛛会大大减少爬行,却不耽误索引新内容。

后续SearchEngineLand对Bing搜索工程师的访谈证实,减少爬行,确实是Bing的目标。他们希望未来几年内,Bing不再依靠爬行来发现新内容。Bing认为,对网站爬行的方法低效、费资源,不如站长直接提交内容。Bing表示,提交URL是页面抓取的“很强”的信号,要想内容被快速索引,就赶紧用提交工具吧。

确实,大型网站,页面被抓取一遍,可能需要几个星期,甚至更长时间,那么网站上有新页面,或老页面内容有更新,要被抓取,也可能会有几个星期的延迟。提交URL是个更快的方法。

其实百度早就在做类似的事,在百度资源平台提交内容是快速抓取新页面的很好方法,小时级收录确实可以在几小时内收录,有时几分钟就收录。不过百度资源平台提交好像不支持老的但有更新的页面。

对SEO行业的潜在影响

如果Google以后也跟进采取这个方法,可能会对SEO行业产生不小的影响。搜索引擎发现、抓取、索引新内容的方式变得更加简单直接,SEO们调整网站结构的必要性和难度将大大降低。

不过也有潜在问题。比如,黑帽SEO们显然不会放过这个机会。以前垃圾内容靠爬行被抓取越来越困难,因为从一个页面到另一个页面的爬行就是个鉴别、过滤的过程。大量主动提交垃圾页面成为可能后,搜索引擎该怎么处理?

再比如,搜索引擎减少爬行,倒是节省资源了,但老的、不更新的页面被重新抓取的次数将大大减少,这会不会导致链接关系计算的不准确、不及时?顺便提一句,不知道为什么总是有人说链接对排名已经不重要了,其实依然很重要。

SEO的基本方法过去十多年没有大变化,但SEO依然是个不断变化的行业。

加油,刚刚买了书

如果百度也能这样就好了

百度也是一样,主动提交和抓取都有。提交不代表一定收录,也会区分优质内容和垃圾内容,也应该需要蜘蛛爬取,不然蜘蛛吃白饭了

我的泡椒影视www.paojiaotv.com,怎么做百度优化也没权重,影视站,我感觉模板还可以啊

zan

或许确实不用担心爬区问题了,因为现在百度根本就不爬咱这站了

加油,赶紧出新书啊

有难度的事情才做出效果

这不靠谱吧,自动化被人工取代?

百度的链接提交接口一直就有 update 的选项,但是上线这么久了始终是在测试阶段,配额永远只有 1。

百度主动提交的效果还是挺不错的,对新站来说

百度的熊掌号提交URL也不错,很容易收录,当然前提文章质量还行。

百度主动提交的效果还是挺不错的

随着搜索引擎技术发展,很多SEO要解决的技术性方面的问题将不是问题,ZAC你说对吗?

谷歌站长工具,网站地图提交,也可以做到每个地图5w链接,每个地图索引可包含5w地图,暂不知索引速度,还在观察,刚在谷歌帮助里看到。

所有搜索引擎都支持siemap.xml,但索引速度不够快,和必应提出的这个提交功能目标不太一样。

现在的SEO越来越难了

提交只可以促进收录,但网站质量差提交也没用,网站质量好也不用提交,蜘蛛自然会收录

很对人说“链接对排名已经不重要了” 是因为目前留外链越来越难了,包括以前的各大平台和论坛….

SEO越来越有深度

retreive=retrieve, 哈哈😄

感觉网站爬行还是必不可少的一项操作,虽然提交链接的方式更加高效,但如果搜索引擎全面放弃爬行,那么会跟雅虎一样是自费武功。

用必应的人还真不多,特别是国内

希望能够谷歌回归吧,必应流量根本不大

加油吧,现在蜘蛛抓取的算法也一直在改动,但是建议大家还是关注这个站点,一般新的算法应该都会更新

没想到这是一个好网站,来晚了。

现在我的小站索引就是一个大问题,头疼中

未来SEO还能长干嘛?

怎么总感觉爬虫不够啊 ,总算太少了

bing的流量虽少,但真的转化高。断断续续的看着第二版实战,要静下心来研究了。

ZAC大神,打扰下,我想问个问题:我网站的sitemap想更换,因为链接超5W了,应该怎么做呢?

如果几十万的链接,要怎么分配链接,安排sitemap呢?

谢谢您!

又是一大利好消息呀!

万变不离其宗

如此就好了.

刚开始做外贸网站SEO,还有很多要学习的东西

手动提交证明了有效果,其它还在学习中

提交链接感觉是辅助蜘蛛的一个工具,对于收录应该只起到帮助作用

未来SEO还能好好的推广产品

天天疯狂爬但是不收录,难怪bing总是干不过谷歌家的,

必就收录挺快的,就是有些认站,百度很看好的站,必应不收录

海量检索不一定是文字

视频音频检索也是一样的